微軟 ( Microsoft ) 發佈 VASA-1 人工智能模型,能夠依據一張照片及一條語音,創建出說話或唱歌的同步動畫影片。

Microsoft just dropped VASA-1.

— Min Choi (@minchoi) April 18, 2024

This AI can make single image sing and talk from audio reference expressively. Similar to EMO from Alibaba

10 wild examples:

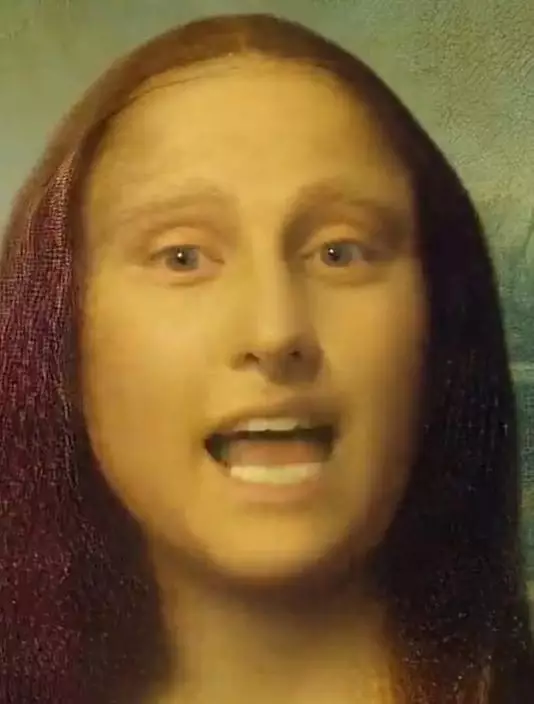

1. Mona Lisa rapping Paparazzi pic.twitter.com/LSGF3mMVnD

影片具真實感且表情豐富

VASA-1 使用機械學習技術分析靜態圖像和語音音訊片段,生成具有精確面部表情、頭部運動和音訊同步的真實影片。Microsoft 稱 VASA-1 在真實感、表情豐富度與效率方面,顯著超越過往的語音動畫方案。該模型不會製作或模擬語音,而是依賴於已有的聲音輸入。研究團隊強調,該技術主要用於研究,而非實際產品或 API 發布。

Twitter影片截圖@minchoi

「蒙娜麗莎」搖身一變會饒舌

在微軟建立的 VASA-1 研究專頁,展示了多個樣本影片,包括以蒙娜麗莎的形象配合 Anne Hathaway在Conan O’Brien 節目中表演的《Paparazzi》歌曲的音訊軌進行饒舌。

Twitter影片截圖@minchoi

模型2018年開始研發

該模型的訓練基於2018年由牛津大學研究人員創建的 VoxCeleb2數據庫,該數據庫包含來自 6,112 名知名人士的超過一百萬條語音資料,這些資料均來自 YouTube。VASA-1 能生成 512×512 像素解像度的影片,每秒最多 40 幅。

Twitter影片截圖@minchoi

微軟:初衷不是製造能夠冒充真實人物的假象

Microsoft研究人員指出,他們的初衷不是製造能夠冒充真實人物的假象,而是探索視覺影響技術生成虛擬互動角色的可能性。他們也意識到這種技術的潛在濫用風險,因此目前不計劃公開此技術背後的程式碼。

4. Out-of-distribution generalization - singing audios pic.twitter.com/h7BvTq4vAE

— Min Choi (@minchoi) April 18, 2024