2015年,時任美國總統奧巴馬於國情諮文中提出 「精準醫療計劃」(Precision Medicine Initiative)。精準醫療強調透過分析個人的生物醫學資料(如基因、身高體重、 血壓血糖、過去病史、家族病史),在傳統的病患症狀描述及常規檢查之後,更精準的提出最適合病患者的個人化治療方法及藥物。2016年,我國發表十三五國家科技創新規劃,其中醫療器械科技是重點的創新專項,目標是推進醫療診斷技術,優化醫療服務,為健康保障體系奠下穩固的基礎。

2018年我城的財政預算案,政府預留500億支持創科發展。筆者於本地人工智能醫療影像初創企業工作,看到政府「會預留一百億元支持建設醫療科技創新平台和人工智能及機械人科技創新平台」,本應十分高興,但繼續閱讀下去發現政府重點為「吸引世界頂尖的科研機構和科技企業來港,與本地大學及科研機構合作進行更多中下游研發項目」,心情則有點複雜。筆者絕對認同基礎研究及吸引科研人才的重要性,但正如立法會議員莫乃光於報導中所形容,似乎政府在支持非牟利機構毫不手軟,但面對私營科研機構就相當卻步,因害怕被指官商勾結,因此令所花的錢不能夠落地。

其實,本地土炮的人工智能科研的水平絕對不能小覷,早前香港中文大學工程學院舉辦了一個人工智能的論壇,展示了工程學院在人工智能方面的科研項目與科研成果。

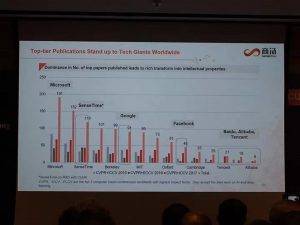

論壇由香港首隻AI 獨角獸商湯科技的創辦人湯曉鷗教授以《人工智能的中國式文藝復興》為題主講,指出以頂尖期刊發表的論文數量來看,中國科技企業目前在AI發展的貢獻仍是不及歐美企業,而商湯正一直在這個領域上努力作出貢獻。

在醫療科技方面,由歐國威教授介紹「外科手術與機械人結合的下一波醫療創新」,歐教授於中文大學機械與自動化工程學系本科及碩士畢業,於美國麻省理工學院完成博士學位,然後加入加州醫療器械公司Intuitive Surgical,參與研發達芬奇(da Vinci) 單創口手術平台。歐教授指出目前手術用機械人的開發遇到最大的技術瓶頸,在物料上如何做到既有彈性而不失堅硬,在導航上如何因應自己的位置與體內的變化做到精準的定位。歐教授以無人駕駛汽車比喻,路本身是大概不會改變的,但身體內的環境是會改變的,而且,手術用的機械人是會與身體有互動,大大提高了定位的技術難度。

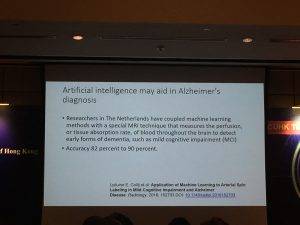

另外,生物醫學工程的湯啟宇教授介紹了人工智能如何應用於醫療保健之上,除了上述提到手術機械人可以幫助外科醫生做手術之外,還介紹了應用人工智能分析磁力共振醫療影像可以協助早期檢測認知障礙症。湯教授主力研究的是機械手與腳,偵測人類移動意圖,協助腦神經病者復康訓練。另外,湯教授亦提及穿戴式裝備能搜集大量的生物醫學數據,以人工智能去分析此等生物醫學數據,有助疾病的預防與治癒。

在另一個訪問中,歐國威教授指出其中一個吸引他從美國回流母校任教的原因,是希望透過「教授進階機械人學以及機械電子學,幫助大學彌合研究樣本與商業產品之間的鴻溝。」歐教授並指出他「在業界工作了接近十年,深知這道鴻溝非同小可,在醫療器械研發領域尤甚。有了好主意,也未必能研發出好的產品。」歐教授此言,正正回應了我城目前在基礎科

研之外,在科研商品化、以致在商品化之後的持續研發與推廣正欠缺關鍵的支持。

筆者曾經聽過申請國內科研基金的講座,講者指出國內的科技企業由國家、省、市,層層都有資助,他們的概念是希望裁培出成功的企業,未來在稅收上可以收回這筆投資之餘,並帶來可持續的收回。筆者不知道此等「官商勾結」的想法在政治或經濟學的嚴謹分析下是否站得住腳,但在我城這個房地產與金融獨大的經濟體系之下,總覺得值得我們深思。

YM Chan

** 博客文章文責自負,不代表本公司立場 **