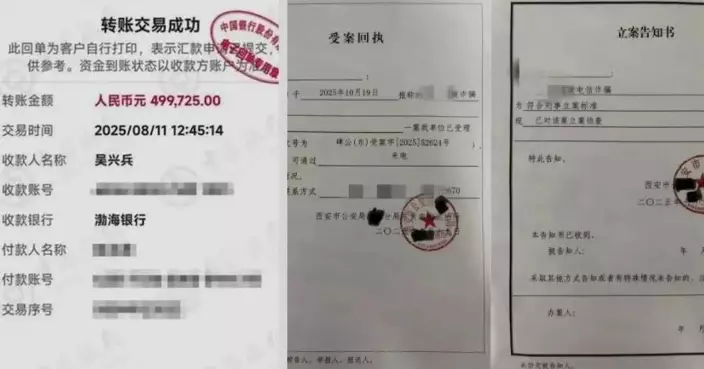

OpenAI3月25日推出了一項新的原生圖片生成功能,一推出就掀起全球熱潮。然而,一些科技專家發現這項新功能竟然還可以偽造發票和帳單,經測試後看起來就和真的發票一樣。

OpenAI推原生圖片生成功能

OpenAI3月25日上線了一項新的原生圖片生成功能,引起使用熱潮。執行長阿特曼(Sam Altman)甚至發文求饒說「我們的GPU都快融化啦!」

4o image generation has arrived.

— OpenAI (@OpenAI) March 25, 2025

It's beginning to roll out today in ChatGPT and Sora to all Plus, Pro, Team, and Free users. pic.twitter.com/pFXDzKhh2t

ChatGPT秒造「超逼真收據」

知名科技網紅暨創投家達斯(Deedy Das)在個人社交平台上貼出一張在舊金山牛扒館的假收據,他表示這是他使用ChatGPT生成功能所製作的,並寫下:「你可以用生成功能製作假收據。以往現實中的驗證流程仰賴『真實影像』作為證明,但那個時代已經結束了,造假變得更加逼真和難以辨識。」其他網友也紛紛貼出假收據或帳單的照片,發現皺巴巴的發票以及有污漬的收據,通通難不倒ChatGPT,製造出來的成品就像是真實的。

You can use 4o to generate fake receipts.

— Deedy (@deedydas) March 29, 2025

There are too many real world verification flows that rely on “real images” as proof. That era is over. pic.twitter.com/9FORS1PWsb

外媒測試現數據誤差

外媒《TechCrunch》網站也測試了一家餐廳的假收據,但發現與原始收據的標點符號以及數字排列出現誤差,暴露出假收據的痕跡。然而該網站也表示,這只是AI運算上的小錯誤,要修正並非難事,甚至只要使用修圖軟件就可以達到造假的效果。

AP圖片

OpenAI發言人克里斯汀森(Taya Christianson)回應表示所有由ChatGPT製作的影像都包含元數據,表明其出處。她補充說,若用戶違反使用政策,OpenAI會「採取行動」,且一直在從現實世界的使用和反饋中「學習」,不會讓新功能變成詐騙工具。

OpenAI發言人:目標是給予用戶「盡可能多的創作自由」

《TechCrunch》進一步詢問,為何允許用戶能夠生成假發票和帳單以及是否違反禁止詐欺的使用政策時,克里斯汀森表示OpenAI的目標是給予用戶「盡可能多的創作自由」,AI假收據除了用於詐欺,也可能出現在「教導民眾理財知識」等非詐欺情境,以及用來創作原創藝術和產品廣告。

示意圖