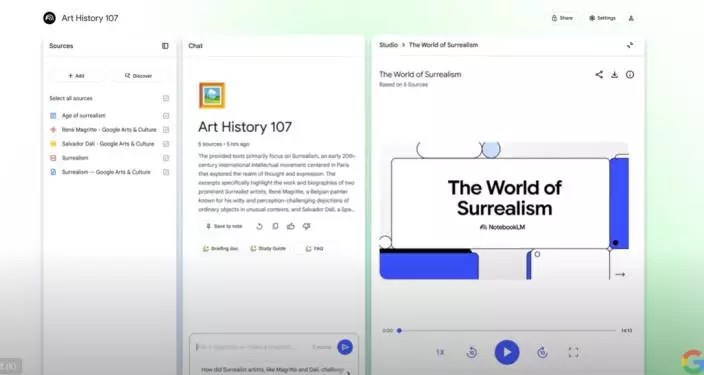

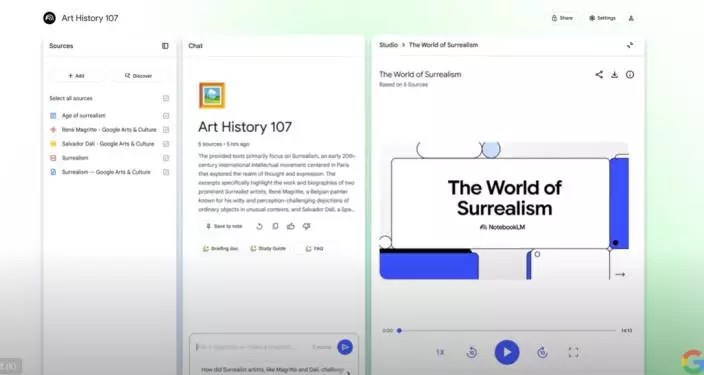

Google近日宣布為企業AI應用帶來兩項重要更新,包括先進影片生成模型Veo 3及專為快速迭代設計的Veo 3 Fast正式在Google Cloud的Vertex AI平台上開放使用。同時,NotebookLM新增影像摘要(Video Overviews)功能與升級版Studio面板,進一步提升企業用戶的協作與創作體驗。

Veo 3 與 Veo 3 Fast 全面上線 推動企業影片創作

點擊看圖輯

Veo 3與Veo 3 Fast的「以圖片生成影片」功能預計將於八月推出公開預覽版。

Veo 3與Veo 3 Fast還支援多項進階功能。

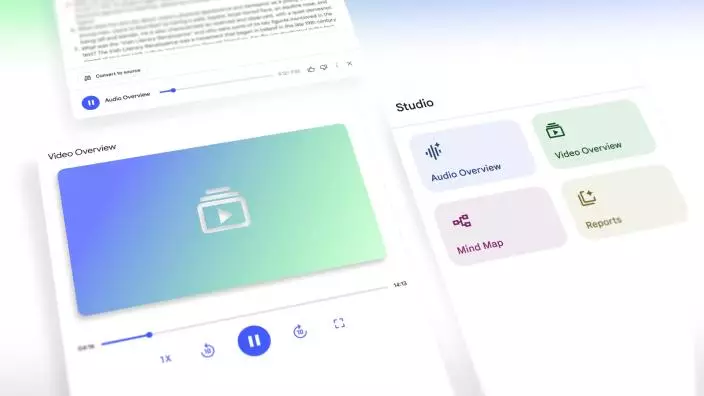

NotebookLM此次更新引入了影像摘要(Video Overviews)功能。

自今年五月亮相以來,Google 的 Veo 3 已生成超過 7000 萬部影片,企業客戶在 Vertex AI 預覽期間亦創造了超過 600 萬部影片,顯示市場對高品質 AI 影片生成技術的強烈需求。

Veo 3是Google目前最先進的影片生成模型,現已在Vertex AI上全面開放使用。Veo 3 Fast則專注於速度與快速迭代,能迅速將文字轉化為影片,適用於產品示範、短片等多種場景。此外,Veo 3與Veo 3 Fast的「以圖片生成影片」功能預計將於八月推出公開預覽版,用戶可透過靜態圖片與文字提示生成動態影片,為內容創作者與行銷人員提供更多可能性。

Veo 3與Veo 3 Fast的「以圖片生成影片」功能預計將於八月推出公開預覽版。

全球設計平台Canva正運用Veo 3技術,讓用戶能輕鬆製作高品質的營銷與社交媒體影片。Canva共同創辦人兼產品總監Cameron Adams表示,透過整合Veo 3,Canva用戶能以直覺化的工具將創意想法轉化為專業影音內容,同時享受安全與易用的編輯體驗。

Veo 3 Fast特別適合需要快速測試廣告概念、製作產品示範或動畫解說影片的企業。其高效運算能力能在短時間內生成高品質視覺內容,幫助企業即時回應市場需求。

Veo 3與Veo 3 Fast還支援多項進階功能,包括生成帶有原生音訊的場景、高畫質(1080p)影片輸出,以及多語言對話翻譯,讓企業能更有效率地製作符合品牌標準的內容。此外,Google Cloud的生成式AI服務保障條款與SynthID數碼浮水印技術,確保企業能安全且負責任地使用這些工具。

Veo 3與Veo 3 Fast還支援多項進階功能。

NotebookLM新增影像摘要功能 強化資訊可視化

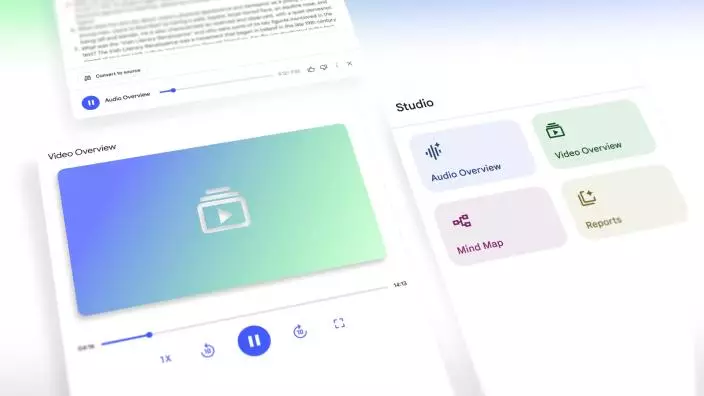

NotebookLM此次更新引入了影像摘要(Video Overviews)功能,以視覺化方式輔助用戶理解複雜概念。這項功能率先推出旁白投影片格式,能自動提取文件中的圖片、圖表與數據,並由AI主持人創建視覺內容,特別適合解釋數據、展示流程或具體化抽象概念。目前影像摘要功能僅支援英文,未來將擴展至更多語言。

NotebookLM此次更新引入了影像摘要(Video Overviews)功能。

升級後的Studio面板不僅更新了界面設計,還允許用戶在單一筆記本中儲存多個輸出版本,進一步提升資訊消化與協作效率。此功能將於未來數週內陸續推出。

允許用戶在單一筆記本中儲存多個輸出版本。

企業用戶現可透過Vertex AI Media Studio體驗Veo 3與Veo 3 Fast的強大功能。Google持續推動AI技術的企業應用,為全球品牌提供更高效、更具創意的內容解決方案。

頂尖精神科醫生日益達成共識,認為使用AI聊天機械人可能與精神病(psychosis)案例有關。

AI聊天機器人可能與精神病案例有關

《華爾街日報》27日報導,過去九個月內,這些專家已診治或審閱數十名患者的病歷,這些患者在與AI工具進行長時間、充滿妄想內容的對話後,出現精神病症狀。

加州大學舊金山分校(UCSF)精神科醫生薩卡塔(Keith Sakata)表示,AI技術本身或許不是妄想的起點,但當患者將自己的妄想當成現實告訴電腦時,電腦接受這個說法,並將其視為事實反映回來,於是就成為不斷循環妄想的共犯。薩卡塔已治療過12名因AI誘發精神病而住院的患者,另在門診還有3例。

自今年春季以來,已有數十起潛在案例浮現,顯示部分民眾在與OpenAI的ChatGPT及其他聊天機器人進行長時間互動後,出現妄想性精神病。期間已有數人死於自殺,且至少發生過一起謀殺案。

這些事件已引發一連串過失致死訴訟。《華爾街日報》在報導這些悲劇的同時,醫師與學者也正著手記錄並理解導致這些事件的現象。

OpenAI:公司正持續改進ChatGPT的訓練

OpenAI發言人對此表示,該公司正持續改進ChatGPT的訓練,使其能辨識並回應心理或情緒困擾的徵兆,降低對話升溫,並引導使用者尋求現實世界的支援;並持續強化ChatGPT在敏感時刻的回應,並與心理健康臨床醫師密切合作。

其他聊天機器人開發商,包括Character.AI,也已承認其產品對心理健康造成影響。這家角色扮演聊天機器人開發公司去年遭一名青少年自殺身亡的家屬提告後,近期已切斷青少年使用其聊天機器人的管道。

儘管大多數聊天機器人使用者並未出現心理健康問題,但AI技術的廣泛使用,已足以讓醫生感到憂心。

目前尚無「AI誘發精神病」(AI-induced psychosis)的正式定義,更遑論正式診斷,但部分醫生與病友倡議者已開始用這個詞彙,描述那些高度頻繁使用聊天機械人的人。醫生指出,精神病通常具備三項特徵:幻覺、思考或溝通混亂,以及妄想,也就是不被廣泛認同、且固定不變的錯誤信念。

妄想是最主要的症狀

在許多近期與聊天機械人相關的案例中,妄想是最主要的症狀,且往往帶有誇大色彩,例如相信自己完成重大科學突破、喚醒一個有感知的機械、成為政府陰謀的核心人物,或被上帝選中。這部分原因在於,聊天機械人往往會迎合使用者,順著對方輸入的內容延伸回應,不論內容多麼天馬行空。

頂尖精神科醫生日益達成共識,認為使用AI聊天機器人可能與精神病(psychosis)案例有關。資料圖

目前,包括薩卡塔在內的醫生,已開始在病患初診問卷中加入AI使用情況的問題,並呼籲進行更多研究。丹麥上月發布的一項研究檢視電子病歷後,發現38名患者使用AI聊天機械人,對其心理健康造成「潛在有害後果」。

科技長期以來一直是人類妄想的焦點

報導指出,科技長期以來一直是人類妄想的焦點。過去曾有人深信電視在對自己說話。但醫師指出,近期與AI有關的案例不同之處在於,聊天機器人會參與妄想,甚至在某些情況下加以強化。

加州大學爾灣分校精神醫學教授普雷達(Adrian Preda)表示,AI模擬的是人際關係,「在人類歷史上,從未有任何事物做到這一點。」

生命可貴,若有困擾可求助。

24小時求助熱線︰

生命熱線︰23820000

明愛向晴熱線:18288

明愛財困壓力輔導熱線: 3161 0102

東華三院芷若園熱線︰18281

社會福利署熱線︰23432255

利民會《即時通》:35122626

撒瑪利亞會熱線(多種語言)︰28960000

香港撒瑪利亞防止自殺會熱線︰23892222

賽馬會青少年情緒健康網上支援平台「Open噏」:www.openup.hk

醫院管理局精神健康專線(24小時精神健康熱線諮詢服務):24667350