人工智能技術逐漸普及,最近流行的聊天AI機械人「ChatGPT」成為熱話。由香港理工大學的人工智能設計研究所(AiDLab)主辨的「Fashion X AI : 2022/23 國際匯展」,展示人工智能與設計所產生的協同作用,計劃由理工大學黃偉強教授和陳芊瑞博士主導,繼去年12月在M+博物館舉行時裝滙演後,今次國際匯展推出一連串活動,揭開序幕的是由即日起到2月26日於荃灣南豐紗廠的展覽。

本地設計師利用AI時裝設計助理(AiDA)設計的時裝

國際設計師利用AI時裝設計助理(AiDA)設計的時裝

人工智能設計研究所 (AiDLab) 是首個結合人工智能和設計的研究所,由理工大學及英國皇家藝術學院共同建立。黃偉強希望,透過計劃推動香港成為世界首屈一指的創科中心,並以AiDLab平台國際領導的地位,促進行業發展,為社會帶來正面影響,因此計劃強調「落地」和「帶入社會」,冀望將科研成果帶離實驗室,進到市民的日常生活。

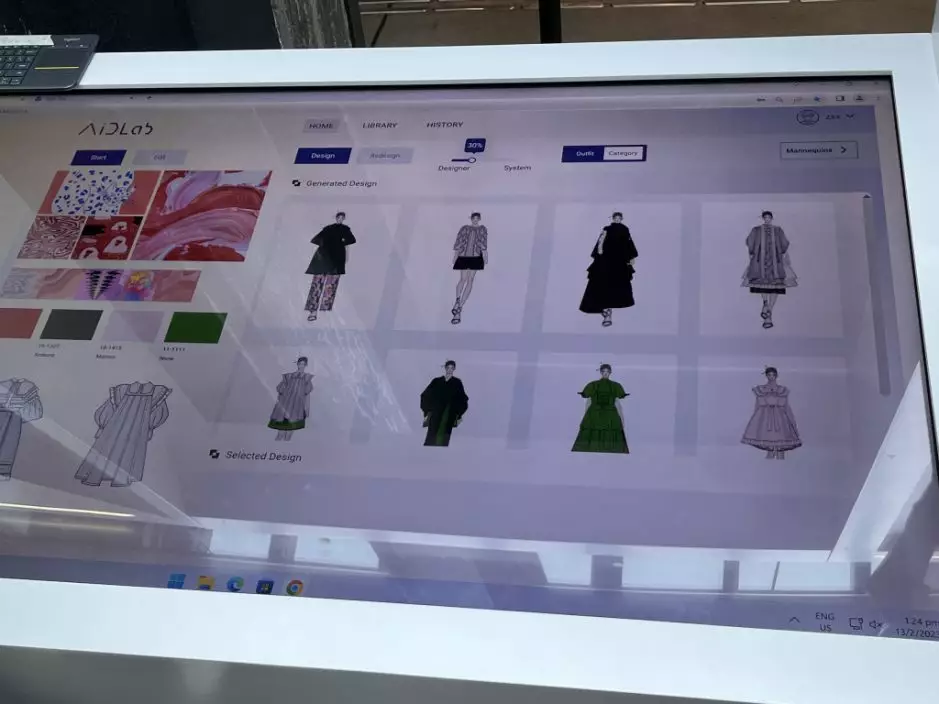

黃偉強教授示範使用AI時裝設計助理「AiDA」

黃偉強教授示範使用AI時裝設計助理「AiDA」

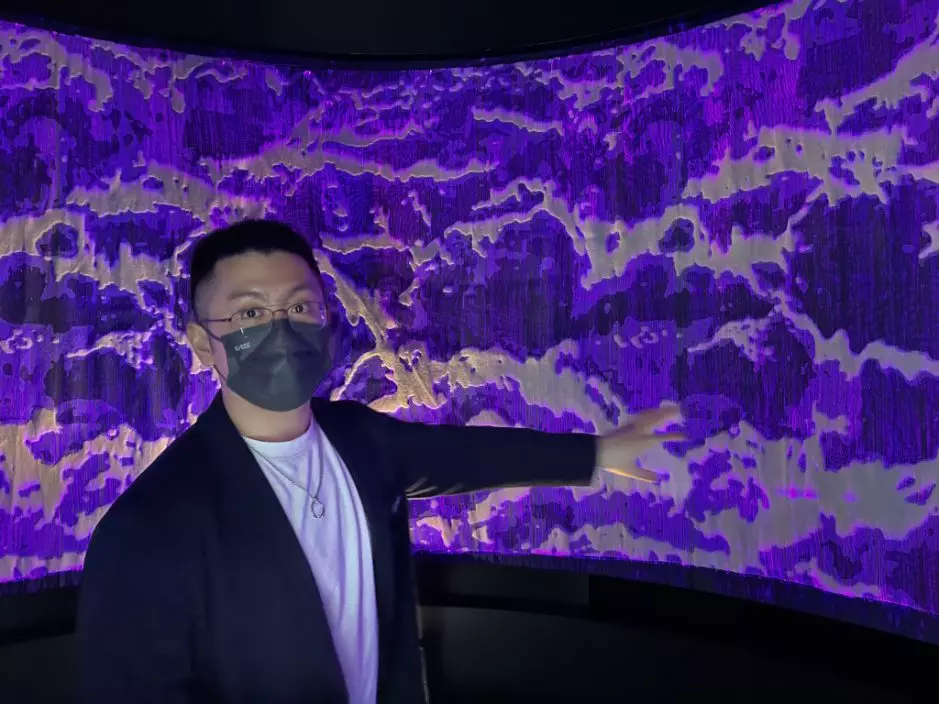

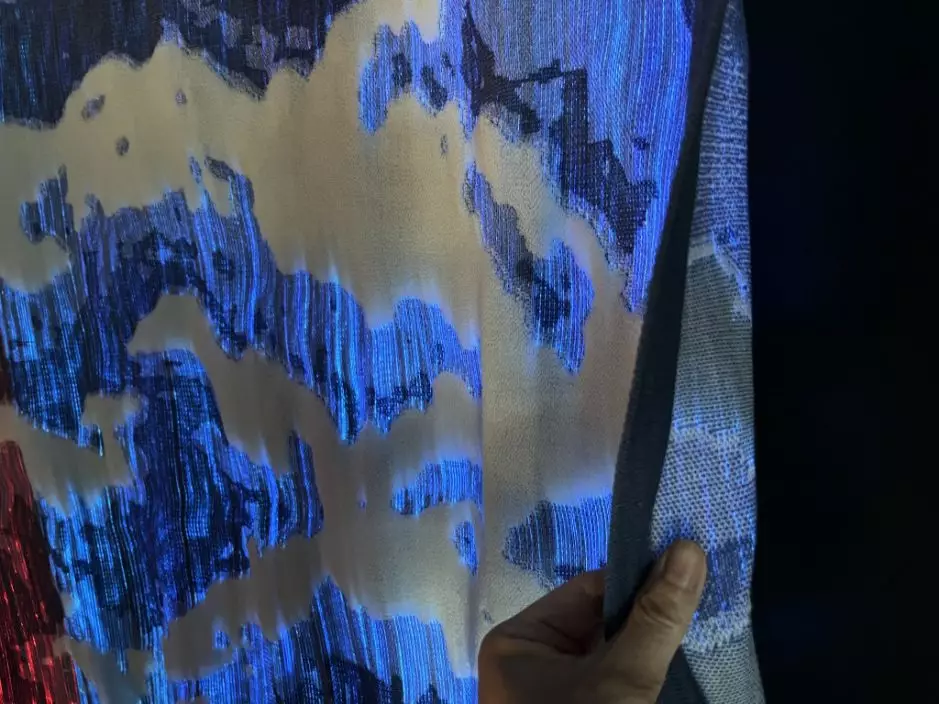

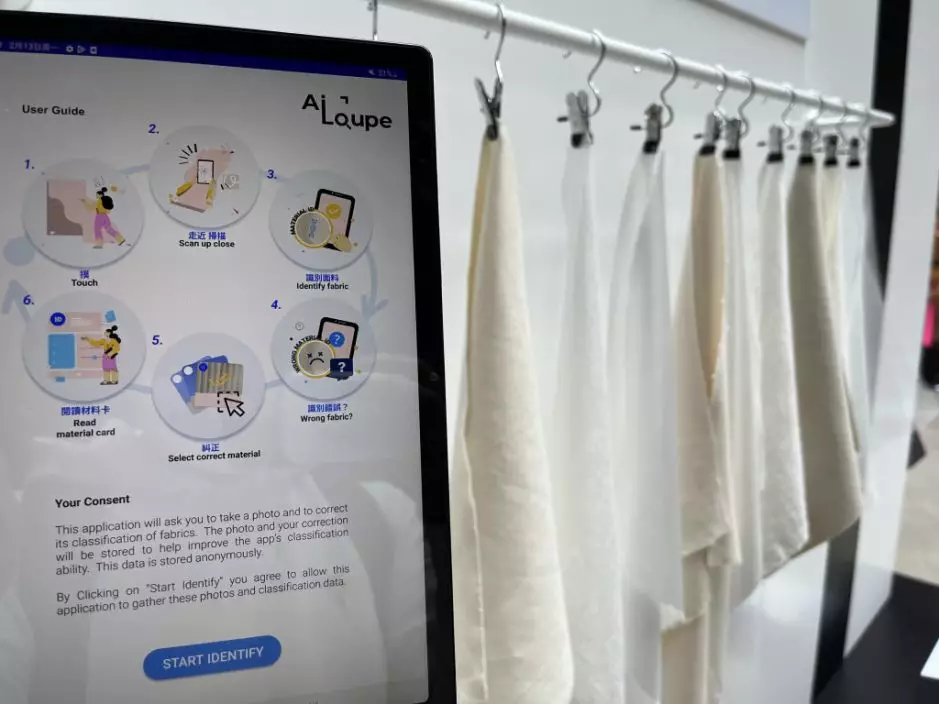

荃灣南豐紗廠的展覽展示不同科研成果,包括互動性人工智時裝設計助理(AIDA)、能發光的人工智能光纖布、可識別不同布料的人工智能等。陳博士與團隊研發的「發光光纖布」已在社會應用,在黃大仙地區健康中心的治療師,利用光纖布共同為認知障礙病人設計多感官刺激療程,當病人做出手勢時,光纖布接收其手勢後轉變顏色並移動位置,而設計上亦富有黃大仙特色,希望令病人更加投入。

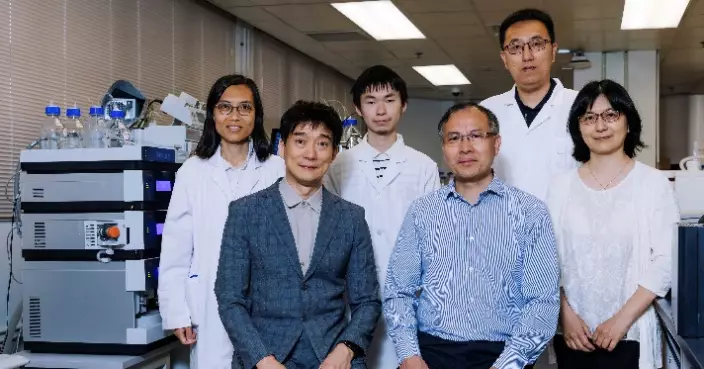

研究團隊介紹能發光的人工智能光纖布

研究團隊介紹能發光的人工智能光纖布

AI亦在人體工程學發揮作用,團隊利用二維的頭部掃描器收據數據,再利用人工智能構建3D模型,根據對象的頭型量身定做眼鏡和頭盔等,協助兒童健康成長,甚至有矯型AI能設計裝備協助脊椎側彎患者糾正問題。

光纖布能隨意拉伸

可識別不同布料的人工智能

AI時裝設計助理「AiDA」是首個以設計師上載的個人設計意念和靈感來產生多幅創新設計圖,整個過程只需十秒。AiDA已於去年12月M+展覽後開始商業化,開設了訂閱服務,已經吸引了多位知名時設計師使用。

香港理工大學黃偉強教授(左)和陳芊瑞博士(右)

Fashion X AI : 2022-2023 國際匯展

黃偉強指,將人工智能引入時裝行業絕非想取代人類設計師,而是擔任一個輔助和啟發的角色,只提供模板供設計師參考或作出微調改善設計,協助設計師更有效率地完成作品。他以與國際著名時裝品牌Antrprima合作例子,他們在AiDA協助下,只用了4日就將傳上需要數個月時間才能繪製的3000張設計圖完成,並篩選出現在展出的的8件設計。

二維的頭部掃描器收據數據,再利用人工智能構建3D模型,根據對象的頭型量身定做眼鏡 (AiDLab提供)

香港理工大學黃偉強教授(左)和陳芊瑞博士(右)