隨著AI發展,人們開始向ChatGPT等聊天機器人傾訴各種疑難雜症,然而,專家指出,有5件事情明顯不應該告訴AI,因為這可能帶來潛在的風險,尤其在工作場景中,可能意外洩露企業機密。

專家警告:這5類資訊絕對不能告訴ChatGPT

史丹佛大學「人本人工智慧研究中心」(HAI)的研究員珍妮佛(Jennifer King)告訴《華爾街日報》,當你向聊天機器人輸入某些信息時,「你就失去了對它的控制權」。

Five things you should never reveal to ChatGPT if you want to protect your privacy https://t.co/B95aARKCjx pic.twitter.com/IOrFFnQvM0

— New York Post (@nypost) April 15, 2025

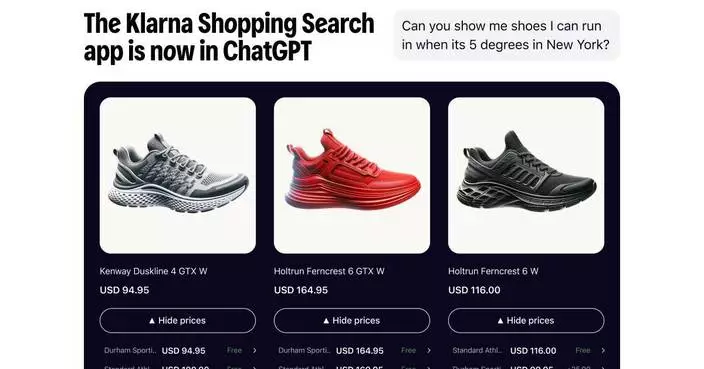

1.企業資訊:

在工作中使用ChatGPT或其他AI聊天機器人時,例如撰寫電子郵件或編輯文件,可能會不小心洩露客戶資料或商業機密。一些公司可能會訂閱企業版AI聊天機器人或使用具有保護措施的定制AI程式,以防止此類問題。

?❓ Atención: la información que nunca debemos revelarle a ChatGPT o a cualquier otra IAhttps://t.co/pVjzGyhW0K

— BeTech (@BeTech_as) April 14, 2025

2.醫療結果:

儘管醫療行業非常重視患者隱私並保護個人資料不受歧視,但AI聊天機器人通常不包括在這一範疇內。如果您覺得有必要向ChatGPT解釋醫療檢測結果,建議在上傳文件之前先進行剪裁或編輯,只保留檢測結果的部分。

示意圖

3.登入資訊:

有些人可能認為AI在執行任務方面能力提高,可以放心提供各平台的帳號密碼給它們,但AI機器人並非保險箱,無法保證這些帳號的安全。請使用「密碼管理工具」來保存這些資訊。

4.身分資訊:

不要向ChatGPT透露任何身分證明資訊,例如生日、地址、電話號碼、身分證號碼或護照號碼。即使一些聊天機器人會對這些敏感資訊進行編輯,最安全的方法是完全避免分享這些資訊。

No compartas estos 5 datos con #ChatGPT: tu privacidad podría estar en peligro. Leer más aquí ?https://t.co/gAKio6KWUF

— Banco Mediolanum (@BancoMediolanum) April 16, 2025

5.金融帳號:

絕對不要提供您的銀行或投資帳號,這些資訊可能會被駭客入侵,導致資金流向遭到監控或盜用。

OpenAI的一名發言人向《華爾街日報》表示,「我們希望我們的AI模型了解世界,而不是個人。我們積極減少蒐集個人資訊。」

建議使用高強度密碼並啟用多重要素驗證

如果您仍希望與AI分享私密資訊,建議使用高強度密碼,並啟用多重要素驗證。人工智能公司「Anthropic」的首席執行官克林頓(Jason Clinton)建議,可以在每次使用完畢後「刪除對話框」,通常企業會在30天後永久刪除這些數據。