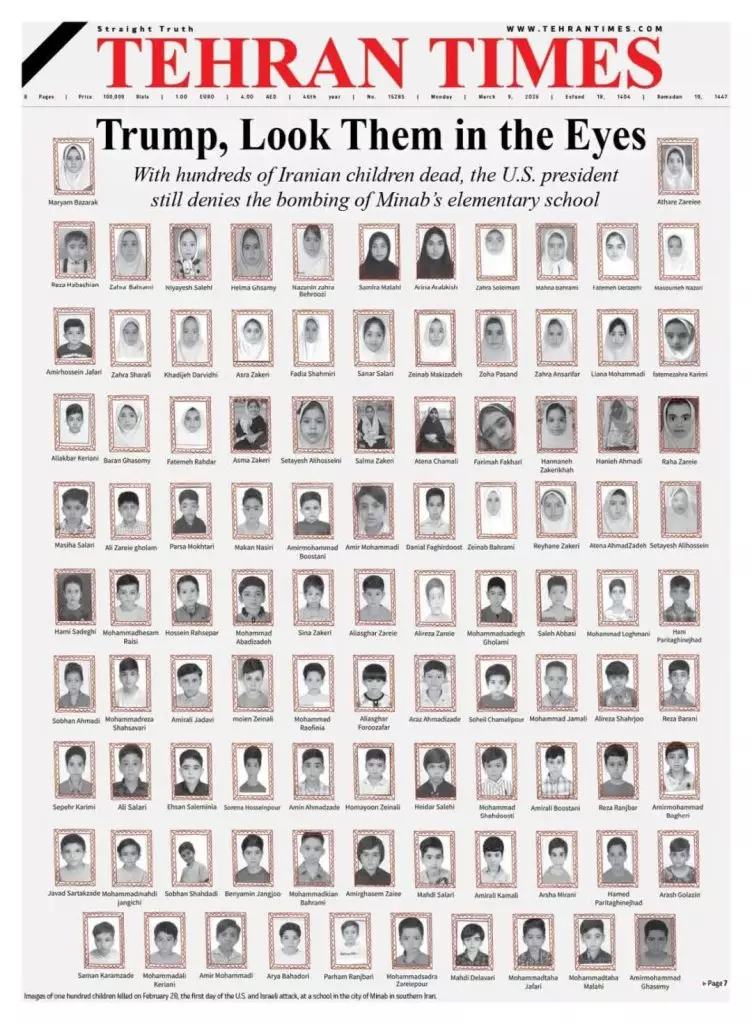

一段睇到既心痛又令人眼都凸的「科技奇聞」。一向自詡擁有「世界最精確情報」和「最嚴謹交戰規則」的美軍,竟用一份可能比小學生年紀還大的過時地圖,搭配最新潮的人工智慧(AI)系統,精準地將一枚戰斧巡航導彈送進了一所擠滿女童的伊朗學校。

令人傷感的是當165條無辜生命在火海中消逝,華盛頓的解釋就從「我們從不以平民為目標」的經典台詞,滑向了「情報過時」和「AI或有責任」的新劇本。這齣由陳舊失誤與新鮮推諉共同主演的荒誕劇,完美詮釋了何謂「美國特色」的雙重標準。

過時地圖與「智能」殺戮——當AI學會了照著錯誤答案考滿分

根據《華盛頓郵報》與《紐約時報》披露,這所位於伊朗米納蔔市的女子學校,早在2015年就已用圍牆與相鄰的海軍基地明確分隔,並粉刷成藍粉色、修建了運動場。然而,在美軍的目標數據庫,它依然被標記為「軍事基地」。這份可能塵封近十年的「古董情報」,在美以對伊開戰的極速節奏下,未經充分核查,便餵給了最新的AI作戰系統。

這套集成了Palantir公司Maven系統和Anthropic公司Claude模型的高科技工具,被美軍將領誇讚為能「數秒內處理海量數據」、「將數星期規劃壓縮為實時決策」的戰場革命者。

兩名熟悉該系統使用情況的人士向《華盛頓郵報》透露,在對伊打擊籌備階段,Maven系統會自動推薦打擊目標、提供精准座標,並按目標重要程度排序;搭配Claude模型後,更是大幅提速作戰節奏,將數周的作戰規劃直接轉為即時行動,系統還會在打擊完成後自動開展效果評估。

諷刺的是,當「垃圾進」,便註定了「垃圾出」。AI以驚人的效率,將這個錯誤的學校坐標識別為「高優先級目標」,並推薦給了決策者。儘管美方堅稱「最終決定由人做出」,但在AI已篩選出數百上千個目標、戰爭機器全速運轉的壓力下,所謂的人工審核早已形同虛設。

結果係,AI沒有創造錯誤,它只是以光速執行了人類的失職。 這套本應消除「戰爭迷霧」的智能系統,反而成為釀成慘劇的「高效加速器」。

一套靈活變動的責任說辭:「絕不針對」變成了「我不知情」。

慘案發生後,美國的應對堪稱「標準流程」的雙標示範:

國防部長赫格塞思:事發前曾大言不慚地向全世界標榜:「與我們的對手伊朗不同,我們從不以平民為目標。」事發後,其辦公室將所有核心問題像皮球一樣踢給了美軍中央司令部。

美軍中央司令部:以「調查仍在進行」為由,拒絕置評。

總統特朗普:之前大大聲話:「根據我所看到的情況,這是伊朗做的。」,依家愈來愈多證據指向美軍時,他僅輕描淡寫地回應:「我對此並不知情。」

從絕對否認,到技術性推諉,再到最高領導人的「一問三不知」,責任已蒸發殆盡。這與美國動輒指責他國「侵犯人權」、「違反國際法」時那種道德審判官般的篤定與嚴厲,形成了刺眼的對照。又在重覆那套劇本:「嚴謹」與「問責」,只適用於審判別人,不適用於反省自己。

雙標的照妖鏡——如果角色互換……

不妨做一個思想實驗:如果被炸毀的是美國或以色列的一所學校,造成上百名兒童死亡,而實施攻擊的國家給出的解釋是「用了過時地圖」和「AI推薦的目標」,國際社會尤其是華盛頓會作何反應?

我們幾乎可以預見那山呼海嘯般的譴責:「野蠻行徑!」「國家恐怖主義!」「赤裸裸的戰爭罪!」聯合國安理會緊急會議、國際刑事法院的調查、毀滅性的經濟制裁與外交孤立……一切都會以「正義」之名迅速降臨。標準之所以為「雙標」,正在於它擁有兩副截然不同的面孔:一副是審判他人的放大鏡,一副是開脫自己的哈哈鏡。

舊地圖與新謊言,都遮不住血跡

這場悲劇最令人心寒之處,不在於技術失誤(這在戰爭中並非罕見),而在於事後那套熟練的、充滿技術官僚冷漠與政治推諉的應對機制。它將鮮活的生命死亡,降解為「數據庫更新不及時」、「AI系統局限性」、「作戰節奏太快」等冷冰冰的技術術語。彷彿那些被燒焦的書包、破碎的童年夢想,都只是現代化戰爭中一個不可避免的、輕飄飄的「系統誤差」。

美國的導彈因「情報過時」在他國領土上製造齋月慘案,並將責任推給「AI」時,其法律團隊正忙於起訴AI公司不該為軍用設置安全限制。這便是頂級的雙重標準:用最尖端的科技,犯下最原始的罪孽;再用最複雜的辭令,逃避最簡單的道義。

最終,無論是發黴的舊地圖,還是閃亮的新AI,或是華盛頓不斷翻新的推責話術,都無法擦去學校廢墟上的血跡。那血跡映照出的,不是技術的失敗,而是一個帝國在道德坐標上早已徹底迷失的真相。

燈塔研究所

** 博客文章文責自負,不代表本公司立場 **