數字辦公室早前公布《生成式人工智能技術及應用指引》,數字政策專員黃志光表示,人工智能AI發展潛能大,既要促進AI科技應用,亦要留意帶來的風險,因此要有相關指引,針對三大持份者,包括技術開發者、應用提供者及用家,關注當中的安全風險及道德倫理,平衡科技創新和應用。

數字政策辦公室數字政策專員黃志光。巴士的報記者攝

黃志光接受港台節目訪問形容,這是一個「活的指引」,需要定期更新,初步認為每年甚或短過一年就要以風險為本進行更新,視乎程度有多高,再建議三大持份者加強相關的關注。

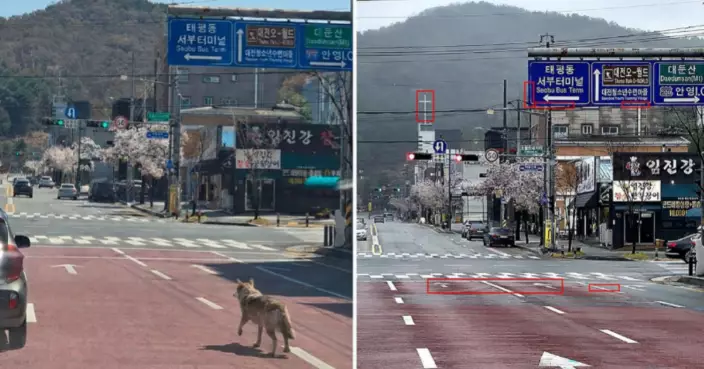

生成式人工智能技術及應用指引

有關指引建議危害及影響市民安全的用途、潛意識操控等屬於「不可接受風險」,建議全面禁止。被問到是否要立法,黃志光認為,香港自由市場容許發展不同科技應用,對於有較高風險的行業,已有專責的法例規管,舉例說,醫療有很的規管框架,如有額外風險,就再加強。

他指出,相關技術發展得太快,如果在模型開發時,提供一些「黑箱數據」,當中可能帶有歧視性,如果用家接受模型提供的內容,就會變成事實的全部。

益普索最新調查顯示,半數歐洲年輕人寧願向聊天機械人傾訴自己的心聲,也不願告訴真實的人,因為聊天機械人永遠在線,並且不評判、不打斷、不疲憊、不匆忙。

6成受訪者將聊天機械人當做精神依靠

據外媒報導,報告指出,在11歲至25歲青少年受訪者中,51%認為通過數字智能介面溝通心理健康話題,比和專業醫護人員面對面交流更加輕鬆。僅有49%曾諮詢過真人從業者,37%求助過心理諮詢師。與此同時,60%的年輕人將聊天機械人當做精神依靠。

觀看影片

聊天機械人隨時待命

聊天機械人的核心魅力,在於模擬全天候傾聽:秒回信息、不會尷尬、不會讓人產生自卑壓力,更不用直面他人審視的目光。據意大利校園平台Skuola.net調查,46%的受訪者會向聊天機械人傾訴自我,近11%每天都這麼做。40.3%的青少年坦言,已經和數字助手建立起情感羈絆。

示意圖。設計圖片

AI不再只是學校工具

AI不再只是用來學習、寫作、查資料的工具,而是闖入了脆弱的情感私密地帶。受訪青年中,60%覺得和AI傾訴的體驗十分治癒,核心原因就是永遠不會被評判。

示意圖。設計圖片

專業人士有時也難以分辨AI與真人

研究作者之一弗蘭克坦言,即便是資深專業人士,有時也難以分辨哪些建議出自AI演算法、哪些來自真人專家。人工智慧24小時隨時待命、程式設定好安撫模式、能適配使用者的說話習慣與內心軟肋。這份研究最殘酷的結論,不是年輕人愛上和AI聊天,而是太多孩子已然覺得身邊再也找不到可以真心傾訴的人。