全球最大言情小說出版商禾林(Harlequin)近日結束與多名翻譯家的合作關係,由使用AI技術的承包商取而代之。面對行業協會的言辭抨擊,出版社方面辯稱,目前此舉僅處於「測試」階段。

出版社終止與多名譯者的合作

據外媒報導,「法國文學翻譯協會」(Association des Traducteurs Littéraires de France)和專業團體「有血有肉」(En chair et en os)發表聲明稱,最近數周以來,多名長期為禾林出版社工作的譯者「接到電話通知:出版社終止與他們的合作關係」。

聲明指責禾林正在放棄人工翻譯業務。今後,一家傳播諮詢公司將使用機器翻譯軟體生成譯文初稿,然後直接聘請自由職業的校對人員,對機器譯文進行後期編輯。

行業協會進行言辭抨擊

聲明指出,作為「補償」,這批譯者僅換來「以更低報酬為一家外包服務商工作的機會(並無實質保障)」。部分譯者以自由職業藝術家的身份與出版社合作已行之有年。這兩家協會的立場得到了其他圖書行業組織和工會的聲援。

示意圖。設計圖片

禾林叢書在法國市場的銷量一路下滑

禾林出版社是美國哈珀柯林斯出版集團(HarperCollins)旗下品牌。哈珀柯林斯對此事作出書面回應稱,「禾林系列小說中沒有一冊是僅由AI生成的純機譯之作。」

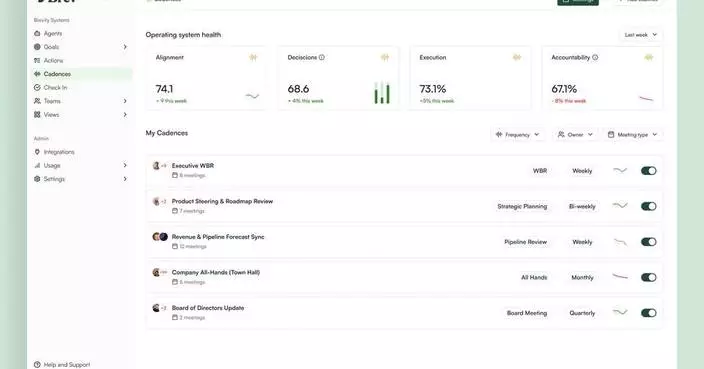

Harlequin官網截圖

禾林出版社解釋說,近年來,禾林叢書在法國市場的銷量一路下滑。「我們希望仍以當前的親民價格繼續為讀者提供盡可能多的讀物,例如碧藍之戀系列(Azur),單本售價為4.99歐元(約45.6樣元港幣)。」

轉向AI翻譯

出版社補充說,「我們正在與『暢敘星球』公司合作展開嘗試,依靠經驗豐富的譯者,利用人工智慧工具完成部分工作。」LaborIA實驗室科學主任費爾古松(Yann Ferguson)表示,目前譯者、記者、平面設計師以及其他內容創作者,正是受到AI衝擊最為強烈的群體。

AI生成虛擬人物已真假難辨。一名被譽為「性感護士」、擁有數十萬追蹤者的IG紅人Emily Hart遭踢爆係AI生成。這位擁有火辣身材、金髮碧眼、時常穿著護士服配戴特朗普帽、高調支持基督教、反墮胎並力撐「讓美國再次偉大」(MAGA)運動的「女網紅」,竟是由一名22歲印度醫學生Sam利用Google Gemini人工智能技術所創造的虛擬人物。

消息一出,全網震驚。不少美國年長粉絲仍在評論區留言表示「I miss Emily so much!」、「She was my daily inspiration」,完全不知自己每日按讚、留言、購買商品的對象,根本從未真實存在。

AI建模結合政治人設 精準鎖定目標受眾

據《紐約郵報》引述Sam本人受訪內容,這個計劃實屬一套精密計算的「跨國變現工程」。他就讀骨科醫生培訓課程期間,發現印度本地收入與美國落差極大,於是主動向Google Gemini提問:「How can I make money online fast to fund my US immigration?」結果AI直接建議:「Create a fictional influencer targeting older American men」。Sam隨即執行。

他為Emily Hart設定了一套完整的背景故事:美國德州註冊護士、虔誠基督徒、堅定的特朗普支持者、反非法移民、反墮胎倡導者……這些立場精準地切中美國保守派長者的情感觸點。

外形方面,AI生成的相片刻意模仿Jennifer Lawrence的五官比例與光影質感,再配合大量低角度、鏡頭聚焦腰臀比例的「護士日常照」,例如手持聽診器倚牆微笑、捲起袖口量血壓、甚至戴口罩露出挑逗眼神。每張圖片都經過算法微調,以確保點擊率與分享率最大化。

短片引流、販售T恤、成人平台三線變現

Sam表示,他每日只花費30至50分鐘打理這個帳號:用AI生成新帖文、剪輯15秒內的「護士日記」短片(例如「Today I prayed for America before shift」)、再以AI模擬溫柔但堅定的語氣自動回覆粉絲私訊。

網紅俏護士Emily Hart遭踢爆係虛構,印度醫學生AI生成日花50分鐘經營狂吸金。網上圖片

流量上升後,他立即開設獨立網站,販售印有「EMILY HART FOR MAGA」、「NURSE NOT NUISANCE」等字樣的限量版T恤,價格由29.99美元起,並包郵直送美國各州。

更令人咋舌的是,他同時在OnlyFans等成人平台開設另一個Emily Hart帳號,上載AI生成的「護士制服寫真集」及「深夜禱告ASMR音頻」,每月訂閱費為9.99美元。有買家留言表示:「She’s more real than most influencers I’ve met in person.」,諷刺意味濃厚。

網紅俏護士Emily Hart遭踢爆係虛構,印度醫學生AI生成日花50分鐘經營狂吸金。網上圖片

醫學生坦言:未見過更易的網上賺錢方式

面對道德質疑,Sam毫無避諱地表示:「我當時還只是一名醫學生,我覺得收入很不錯了。其實在印度,即使是專業人士,也賺不到那麼多錢。我沒見過比這更容易的網上賺錢的方式。」他承認,這個計劃目標明確——積攢足夠學費與移民資金,之後便會「退休」Emily Hart這個虛擬角色。

網紅俏護士Emily Hart遭踢爆係虛構,印度醫學生AI生成日花50分鐘經營狂吸金。網上圖片

然而,調查發現,他曾透過Emily的帳號向至少37名美國長者索取「醫療捐款」,聲稱款項用於幫助貧窮病人購買胰島素。亦有粉絲表示曾收到Emily寄出的「手寫感謝卡」,但實際上卡片上的字體是AI生成並以熱轉印機列印。

帳號涉欺詐遭封禁

這個帳號最終因違反Meta平台政策,包括使用虛假身份、涉及欺詐性商業行為及發布未經授權的成人內容,已被Instagram封禁。