外國傳媒The Information報道,DeepSeek正尋求首次外部融資,尋求以不低於100億美元的估值,籌集至少3億美元的資金,打破「從不融資」鐵律。

報道稱,對沖基金幻方量化旗下的DeepSeek,多次拒絕了國內風險投資基金和科技巨頭的投資意向。創辦人梁文鋒一直希望保持DeepSeek的獨立性,不受商業壓力的干擾。

Deepseek創辦人梁文鋒(右)

DeepSeek V4的發布時間一再推遲

DeepSeek上一次發布新一代模型R1是在2025年,如果此次融資成功,DeepSeek就可以擁有更多算力,同時還能開出更高薪酬,防止頂尖研究者流失。

DeepSeek V4的發布時間一再推遲,與此同時AI圈的競爭環境已經大變樣。有報道指或許這種壓力終於促使DeepSeek轉變融資策略。

V4是一場萬億參數的硬仗,The Information指,V4原定今年2月亮相,但已延遲多次。外電4月初稱最新時間是「未來幾周內」。V4采用MoE架構,總參數約1萬億,但每個token僅激活約370億參數,推理成本與V3持平。

英國《金融時報》報道,V4將是DeepSeek首個原生多模態模型,支持文本、圖像和視頻生成。此前DeepSeek的模型一直以純文本為主,而其他旗艦模型早已擁抱多模態。

中國的AI發展迅速。AP圖

《華爾街見聞》指,DeepSeek近日在內蒙古烏蘭察布招聘服務器運維工程師和交付經理,這是公司首次公開招聘算力基礎設施相關人員。

種種跡象表明,V4已經不在實驗室里了,而是在為大規模部署做最後準備。

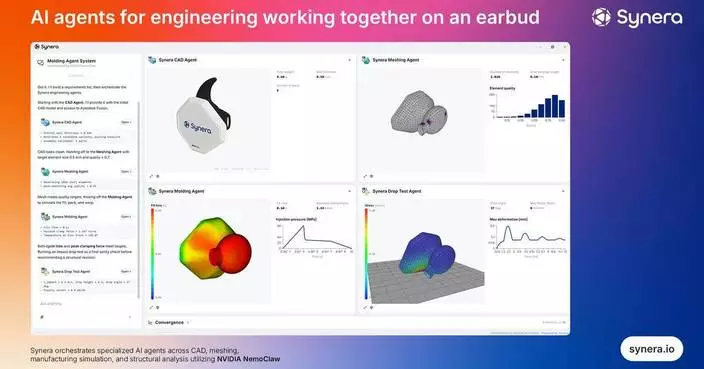

DeepSeek V4從英偉達轉移至華為

DeepSeek之前所有模型都基於英偉達芯片訓練。但V4走不同的路。據外電報道,V4將運行在華為最新的昇騰芯片上。DeepSeek的工程師們花了大量時間解決V4對華為芯片的適配問題,重寫核心代碼,從英偉達的CUDA生態遷移到華為的CANN架構。

AP圖片

DeepSeek刻意沒有給英偉達和AMD提前提供V4做優化適配,而是將早期訪問權限獨家給了國產芯片廠商。如果V4在華為芯片上跑出有競爭力的性能,將是全球第一個不依賴英偉達的前沿AI模型。

英偉達行政總裁黃仁勳曾表示,DeepSeek基於華為平台的新模型「對美國來說將是一個糟糕的結果」。

以「花小錢辦大事」著稱的DeepSeek,再無法僅靠幻方量化一家持續輸血。

據史丹福大學2026年度AI指數報告,截至今年3月,美國頂級模型與中國最強競品之間的性能差距僅剩2.7個百分點。差距越小,每一步追趕的邊際成本越高。

就在本月,OpenAI剛以3000億美元估值完成400億美元融資,相比之下,3億美元也算不得天文數字。

《華爾街見聞》指,V4真正的賭注,在於它要證明前沿AI可以完全脫離英偉達生態獨立運轉,3億美元押的就是這一注。

AI晶片龍頭英偉達行政總裁黃仁勳(AP圖片)