個人資料私隱專員公署近日關注到,OpenClaw 及其他代理式人工智能(Agentic AI)的使用安全風險引發討論。公署提醒機構及市民,在部署或使用此類 AI 前,必須充分了解其涉及的個人資料私隱及安全風險,慎防資料外洩、系統被惡意接管等網絡安全威脅,並採取充足有效的防護措施。

私隱專員公署

代理式 AI 權限更高 風險更甚

公署指出,代理式 AI 與一般用於文字回覆或內容生成的 AI 聊天機械人不同,其用途更為廣泛。它通常是一個可部署於本機或伺服器的高權限 AI 代理工具,能夠讀寫本地檔案、調用系統資源、操作外部服務,甚至可按預設流程自主執行多步驟任務,例如處理電郵、訂座或繳費,過程無需用戶即時參與。

私隱專員公署提醒機構及市民,在部署或使用OpenClaw 及其他代理式人工智能(Agentic AI) 前,必須充分了解其涉及的個人資料私隱及安全風險,慎防資料外洩、系統被惡意接管等網絡安全威脅,並採取充足有效的防護措施。

正因如此,從保障個人資料私隱的角度看,代理式 AI 的相關風險遠高於一般 AI 聊天機械人。

具體風險包括:

- 高權限存取風險:代理式 AI 預設存取權限較高,可接觸使用者裝置上的檔案、電郵、帳戶憑證及瀏覽器儲存內容等。若權限設定不嚴,可能導致大量個人資料被第三方未經授權查閱、複製甚至外洩。AI 亦可能因錯誤理解指令而誤刪用戶重要資料。

- 系統漏洞風險:這類具高權限、可接觸多個系統的 AI,一旦在設計或安全控制上出現漏洞,將對個人資料私隱及整體資料保安構成重大威脅。

- 插件安全風險:若代理式 AI 允許安裝各類 Plugins 或 Skills,而當中未經嚴格安全審核的程式可能夾帶惡意代碼,讓黑客有機可乘,入侵並接管用戶帳戶乃至整個電腦系統,導致敏感資料外洩。

私隱專員公署提醒機構及市民,在部署或使用OpenClaw 及其他代理式人工智能(Agentic AI) 前,必須充分了解其涉及的個人資料私隱及安全風險,慎防資料外洩、系統被惡意接管等網絡安全威脅,並採取充足有效的防護措施。

公署提出五項安全使用建議

為應對上述風險,公署建議機構或市民在使用代理式 AI 處理個人資料時,特別留意以下幾點:

- 授予最小權限:不應隨便向 AI 提供機密或敏感個人資料(如身份證、銀行帳戶及密碼),只授予其完成任務所需的最小權限,避免使用管理員帳號權限。

- 使用官方最新版本:應從官方渠道下載最新版本,避免使用第三方或陳舊版本,以降低因系統漏洞未修補而導致的資料外洩風險。

- 確保系統與資料安全:採取足夠措施,例如將運行環境隔離於本機或伺服器、加強網絡控制、嚴格控制互聯網暴露面、降低權限及建立有效防護機制。

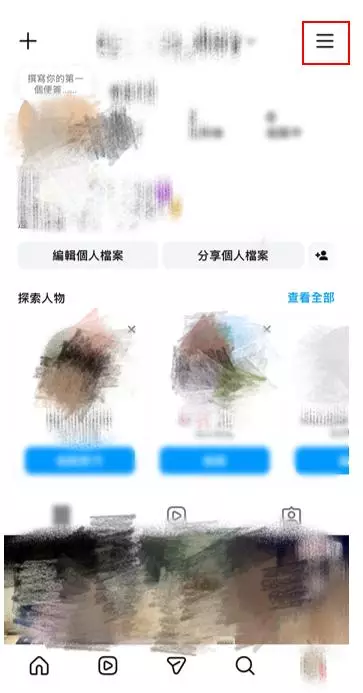

- 審慎安裝及使用插件:核實相關程式為官方最新版本,審視程式有否惡意代碼;如不確定其安全性,應避免使用。

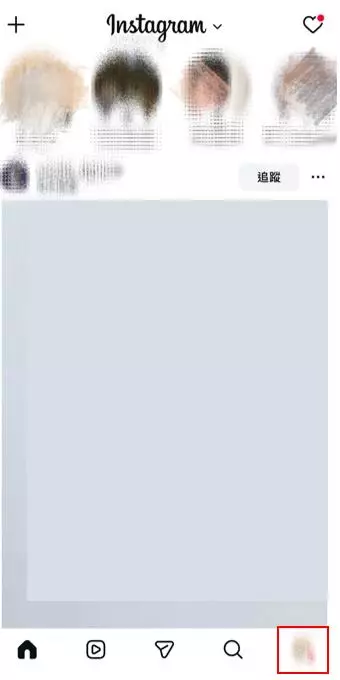

- 持續評估風險:用戶應持續評估風險,留意 AI 是否要求執行高風險操作。若 AI 的決定可能對個人造成重大影響,應考慮採取「人在環中」策略,在發送數據、修改系統配置等關鍵決策中保留最終控制權。

專為人工智能代理而設的社交網絡Moltbook。AP圖片

公署亦建議,機構在使用 AI 工具處理個人資料時,可參考其發布的《人工智能 (AI):個人資料保障模範框架》。該框架反映了國際認可的規範及最佳行事常規,有助機構訂立 AI 管治政策,加強保障個人資料私隱,並遵從《個人資料(私隱)條例》的相關規定。