日本AI新創公司的一項研究顯示,生成式人工智慧在頂尖大學入學考試中的答題能力正飛速躍進。

GPT-5.2で理III首席越えとの事😳

— 限界助教|ChatGPT/Claude/Geminiで論文作成と科研費申請 (@genkAIjokyo) April 27, 2026

少なくとも受験の物差しでは人間は敵わないレベルまで来てますね

【首席超え・満点続出】2026年度 東大・京大の入試問題をAI(ChatGPT / Gemini / Claude)に解かせてみた【採点協力:河合塾】|遠藤聡志 | LifePrompt, Inc. @endo_lifeprompt…

兩年間由「全科落榜」到「全科榜首」

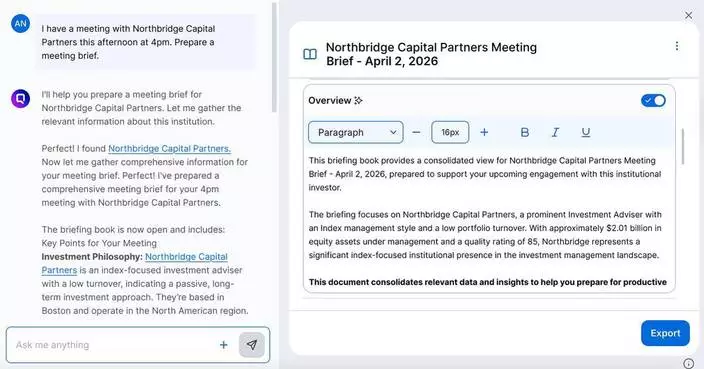

東京LifePrompt公司於5月27日公布的分析結果指出,該公司使用ChatGPT 5.2 Thinking、Claude 4.5 Opus及Gemini 3 Pro Preview等多個頂尖大型語言模型,解答了今年東大與京大的入學試題。

結果顯示,ChatGPT在東大文、理共六個科別的總分均已超越今年實際錄取的人類最高分。尤其對比2024年的同類測試,當時ChatGPT在東大考試中仍處「全科落榜」水平,僅兩年時間其應試能力已有突破性成長。

— ふぉげふ (@fogeff) April 27, 2026

理科表現卓越

測試詳情顯示,在總分550分的東大考試中,ChatGPT於理科一至三類獲得503分,遠高於真人理科三類榜首的453.6分,領先幅度顯著。即使在公認難度高的理科數學卷中,ChatGPT亦能取得滿分。

AIの東大入試の得点を見ると、全体として文系科目の点数が低い。

— IT navi (@itnavi2022) April 27, 2026

記事の解説によれば、日本語での記述力に課題があるようだ。

ただし、今回使用されたのはGPT-5.2などの旧モデルであり、記述力が向上したGPT-5.5などの最新モデルであれば、もっと点数が伸びていたはず。https://t.co/5xWPBYVy8c https://t.co/h2Xqyk8DdV pic.twitter.com/dY19GqVN1F

然而,在文科一至三類,其得分為452.7分,雖仍高於文科三類真人榜首的434.96分,但領先幅度較小。在文科的世界史申論題中,ChatGPT僅獲約25%的分數,凸顯其處理需要複雜論證、史觀分析的非固定答案題型時,能力仍有明顯局限。此弱點在如Claude與Gemini等受測模型中,也可以見到。

跨模型比較與評分方法

是次分析將大學入學共通考試成績與各校自行舉辦的「二次考試」分數合併計算,並與今年實際榜首成績比較。為確保評分公允,試卷中的申論題部分均由日本大型補習班河合塾的講師負責閱卷批改。

生成式人工智慧在頂尖大學入學考試中的答題能力正飛速躍進。資料圖片

結果亦顯示,不同模型的表現存在差異。例如,Claude模型在東大文科部分類別及京都大學多個學部的測試中,分數仍低於真人榜首;而Gemini模型雖在東大全科超越榜首,但同樣呈現「理科優勢大、文科優勢小」的格局。